引言:为什么你的vLLM吞吐始终上不去?

很多团队把vLLM当成“一键部署”的demo来跑,却忽略了它真正的系统能力。结果就是:GPU利用率上不去、首令牌延迟飘忽不定、并发一高就频繁抢占。根据实测经验,大部分LLM服务栈的瓶颈不在算力,而是KV-bound——KV缓存配置不当,再好的GPU也发挥不出应有的性能。本文将带你从单卡配置入手,逐步深入到多卡并行部署,系统梳理从内存调优到分布式扩展的全链路优化思路,帮助你真正压榨出vLLM的吞吐潜力。

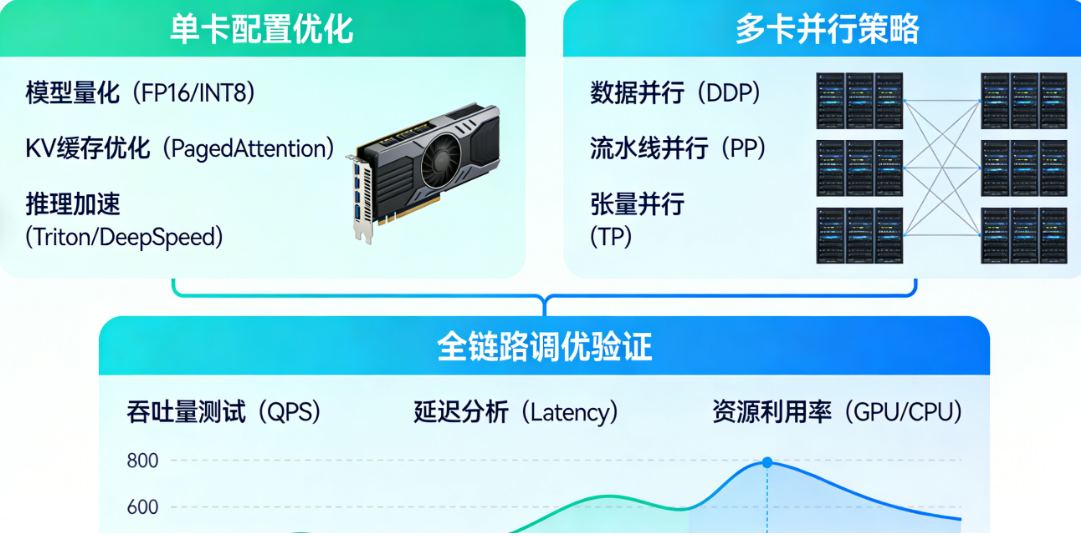

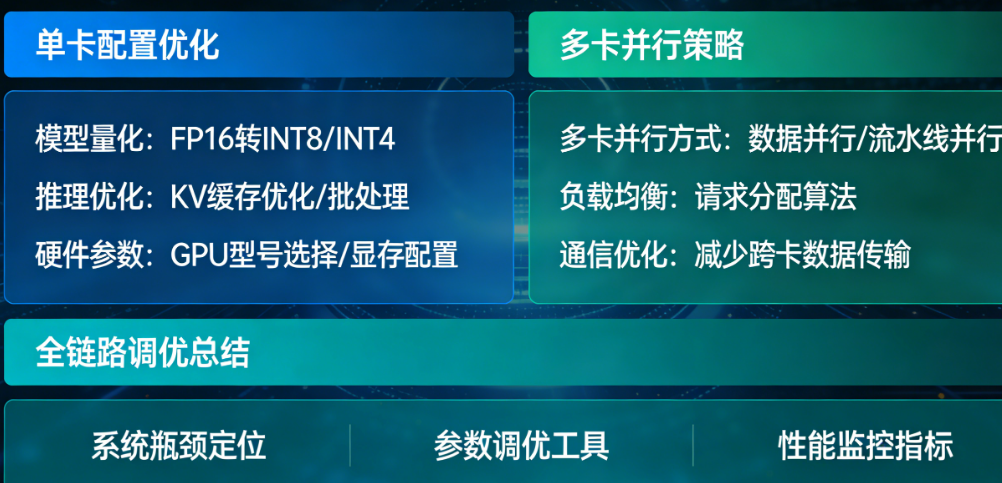

一、单卡配置:打好内存与批处理的基础

1.1 给KV缓存足够的内存空间

vLLM启动时会预分配一大块显存给KV缓存使用。如果分配得太保守,批处理规模会急剧下降,吞吐量也跟着崩。两个关键参数需要重点调优:–gpu-memory-utilization控制预分配的激进程度,–max-num-seqs限制并发序列数,避免内存碎片和频繁抢占。

建议将利用率逐步调高至0.90以上,直到不再频繁出现preemption警告。当你看到日志中出现“Sequence group is preempted”时,说明KV缓存空间已经不足,此时要么继续调高gpu-memory-utilization,要么适当降低max-num-seqs。对于A100级别的卡,可以从64-128起步,向上调整直到TTFT开始变差为止。

1.2 FP8量化KV缓存:硬件支持时的性能倍增器

注意这里量化的是KV缓存本身,不是模型权重。降到FP8之后,同样的显存能塞下更大的上下文,批次规模也能跟着扩大,吞吐自然就上去了。配置方式很简单:–kv-cache-dtype fp8_e5m2。

但这里有几个坑必须注意:FP8支持强依赖硬件和后端实现。Hopper/Ada架构(H100、RTX 4090)和AMD MI300系列可以跑,Ampere(如RTX 3090)就不行。而且部分attention后端根本不支持FP8模式,开了反而会更慢。如果开了FP8但吞吐反而掉了,多半是掉到了慢速路径上,需要切换后端或恢复dtype重新测试。

1.3 分块预填充:让解码和预填充并行

长prompt在预填充阶段会把GPU算力全占了,解码只能干等着。分块预填充把大段的预填充分成小块,这样就可以和解码token交错执行,GPU利用率也能保持在高位。在混合长度请求的场景下,端到端吞吐提升相当明显。

新版本vLLM默认开启了分块预填充,但你可以通过调整max_num_batched_tokens来进一步调优性能:较小的值(如2048)能获得更好的token间延迟,因为预填充对解码的干扰更少;较大的值则能获得更好的首令牌时间,因为可以在一个批次中处理更多预填充token。为获得最佳吞吐量,建议设置max_num_batched_tokens > 8192,特别是在大GPU上跑小模型时。

1.4 前缀缓存:白捡的性能提升

两个请求共享相同前缀时——比如固定的system prompt、统一的few-shot示例——vLLM可以直接复用KV缓存,这是零成本的性能加速。但前缀缓存的命中条件比较苛刻:vLLM的prompt缓存基于PagedAttention,粒度是block级别的。哪怕一个block里只有一个token不一样,整个block就没法复用。

想提高命中率,需要做标准化处理:让前面的token尽可能对齐到block边界,系统提示词跨租户标准化,few-shot示例保持完全一致,变量放用户输入里别放示例里。RAG场景就把模板和指令缓存起来,每个请求只追加检索到的事实。

1.5 推测解码:降低内存带宽瓶颈

当瓶颈卡在内存带宽上时,推测解码能帮上大忙。让一个轻量级的草稿模型先猜几个token,大模型只负责快速验证接受或拒绝。实测下来,根据请求类型和上下文长度,加速比能到2.5倍左右。配置方式:–speculative-model指定草稿模型,跑个快速A/B测试后调整接受阈值。

二、多卡并行:从单节点到多节点的扩展策略

2.1 选择正确的并行策略

vLLM支持多种并行策略,需要根据模型大小和硬件配置灵活选择:

单GPU:如果模型可以装入单卡,分布式推理没有必要,直接在该GPU上运行即可。

单节点多GPU使用张量并行:如果模型太大无法装入单卡,但可以在单节点的多个GPU上装下,使用张量并行。例如在4卡节点上设置tensor_parallel_size=4。张量并行将模型参数在每个模型层的多个GPU之间分片,是单节点内大型模型推理最常用的策略。

多节点多GPU使用张量并行+管道并行:如果模型太大无法装入单节点,需要组合使用张量并行和管道并行。将tensor_parallel_size设为每个节点的GPU数量,将pipeline_parallel_size设为节点数量。例如在2个节点(每节点8卡)上,设置tensor_parallel_size=8和pipeline_parallel_size=2。

边缘情况:如果模型可以装入单节点但GPU数量不能均匀整除模型大小,启用管道并行并设置tensor_parallel_size=1,pipeline_parallel_size设为GPU数量。此外,如果节点上的GPU没有NVLINK互连(如L40S),应优先使用管道并行而非张量并行,以获得更高的吞吐量和更低的通信开销。

2.2 优化节点间通信

高效的张量并行需要快速的节点间通信,最好通过InfiniBand等高速网络适配器。启用GPUDirect RDMA可以进一步优化:网络适配器直接访问GPU内存,绕过CPU和系统内存,减少延迟和CPU开销。

配置时需要注意:为容器添加IPC_LOCK能力以锁定内存页面,挂载/dev/shm提供进程间通信的共享内存。确认是否生效的方法:运行NCCL_DEBUG=TRACE vllm serve …,如果日志中出现[send] via NET/IB/GDRDMA,说明NCCL正在使用带GPUDirect RDMA的InfiniBand,这是高效的;如果出现[send] via NET/Socket,则说明使用了原始TCP套接字,跨节点张量并行效率会大打折扣。

2.3 MoE模型的特殊处理

对于混合专家模型(如DeepSeekV3、Qwen3MoE、Llama-4),可以利用专家固有的并行性。vLLM支持将数据并行注意力与专家并行或张量并行的MoE层相结合的大规模部署。通过设置enable_expert_parallel=True启用专家并行,这将使用与张量并行相同的并行度来分片专家层。

三、容量规划与监控

3.1 用令牌率而非QPS规划容量

两个请求QPS一样,令牌的预算可能天差地别。规划容量要用输入加输出的令牌/秒。设C是选定批处理形状下单GPU的持续令牌/秒,容量约等于GPU数量×C×利用率。利用率保持在70-85%能吸收峰值,再高就该横向扩展了。有时候90%的利用率会莫名其妙的慢,所以尽量不要到达这个临界值。

3.2 必须监控的关键指标

仪表板最少得有这些:TTFT的p50和p95、令牌/秒(输入、输出、总计)、活跃序列数和KV缓存利用率、批处理大小分布、调度器队列长度、OOM和驱逐事件。当活跃序列数饱和或KV缓存接近100%时TTFT p95会飙升,说明容量到头了,需要横向扩展或减小模型长度。

常见问题

问:生产环境应该保留多少显存余量?

建议将gpu-memory-utilization设为0.85-0.90,留出10-15%的余量应对流量尖峰时的OOM。

问:长上下文场景如何优化?

如果大多数请求比最大模型长度短,但仍需要偶尔处理长请求,设置高最大长度会负面影响性能。可以引入VLLM_TPU_MOST_MODEL_LEN环境变量,将请求按长度分类,短请求获得更好的批次密度。对于CPU场景,考虑使用滑动窗口注意力配合混合KV管理器,只保留最近窗口内的KV,长序列下的缓存增长能控制得很死。

问:权重量化和KV量化如何选择?

GPU内存紧张、调度器塞不下足够多序列时建议量化。AWQ或RTN做4-bit权重量化,内存省了不少,perplexity几乎不掉,这是服务端点的默认选择。KV量化同样能减少缓存占用,从而跑更多并发序列。更多并行序列带来的收益通常远超全精度权重那点质量提升。

问:多模态模型的KV缓存怎么规划?

跑视觉语言模型时,图像等模态会像文本token一样在KV里占位置,这会悄悄压缩并发序列的空间。规划max-num-seqs和内存利用率时要把多模态token算进去,不然加了视觉功能后会发现批次莫名其妙变小了。

结论:让vLLM真正干活

vLLM的核心价值不是prompt技巧,是让GPU一直干活。从单卡配置开始,给KV缓存足够空间、在硬件支持时启用FP8量化、确保分块预填充开启、标准化prompt结构提升前缀命中率,这些基础调优已经能让吞吐量翻倍。当需要进一步扩展时,根据模型大小选择正确的并行策略——张量并行适合单节点内的大型模型,管道并行适合跨节点分布,专家并行专门为MoE模型优化。再加上合理的容量规划和监控,你的vLLM服务才能真正发挥出生产级潜力,持续输出高令牌/秒,同时保持延迟稳定可控。

途傲科技服务引导

vLLM的性能调优涉及参数配置、并行策略选择、网络通信优化等多个专业领域,对于没有专门运维团队的项目来说,试错成本可能相当高。途傲科技网汇聚了众多精通大模型部署优化的技术服务商,他们不仅熟悉vLLM的各种调优参数,更有丰富的A100/H100集群实战经验。你可以在平台的“任务大厅”发布一个vLLM部署优化的定制需求,清晰描述你的模型类型、硬件配置和吞吐量目标。平台会智能匹配经验丰富的服务商,你可以在“人才大厅”浏览服务商的商铺案例和历史评价,直观了解其专业能力。“服务大厅”和“一品商城”还提供经过验证的部署模板和优化方案,帮助你快速启动项目。通过“雇主攻略”学习项目管理技巧,善用“V客优享”会员权益,让技术难题迎刃而解。途傲科技汇聚百万专业服务商,覆盖AI部署、系统优化等文化创意服务,助你以“轻资产”模式高效落地大模型应用,让你的AI创意真正跑起来。